2026年3月30日 / 施工およびテスト、アップグレードおよびトラブルシューティング

800G データセンターへの移行は、AIやHPCの進化により急速に現実化しています。本記事では、800Gおよび1.6T、さらに3.2T時代に向けたインフラ設計、技術選択肢、そして現場での測定・検証ポイントまでを解説します。

特に、PAM4、MPO、挿入損失、反射対策といった高速通信特有の課題にフォーカスします。

※本記事は、Fluke Networks の許諾のもと、同社ブログ記事「Is your data center ready for 800G and beyond?」を原文に基づき翻訳・掲載しています。

以下は、Fluke Networksのブログ記事「Is your data center ready for 800G and beyond?」の原文(英語)です:

400ギガビット(G)のアプリケーションが登場したのは、つい昨日のことだったでしょうか?現在、データセンターは高性能なワークロードを支えるために、800Gおよび1.6テラビット(T)のスイッチ速度へと急速に移行しています。大手企業(Amazon、Google、Meta など)は、すでに3.2Tを視野に入れています。IEEE 802.3df 800G標準(2024年)およびシグナリング技術の継続的な進歩により、データセンターはより高速な通信を導入するための複数の選択肢を得ています——ただし、考慮すべき点があります。詳しく見ていきましょう。

データセンターにはなぜ高速通信が必要か(800Gデータセンターの背景)

エンタープライズデータセンターでは、ここ数年にわたり、スイッチ間リンクにおいて400Gイーサネットの採用が進んできました。800Gは、スイッチからサーバーへのリンクにおける8×100Gおよび2×400Gのブレークアウト用途に最適な技術であるため、現在ではエンタープライズレベルでも導入が始まっています——特に、オンプレミスAIの試行を行っている大規模な企業において顕著です。これらの先進的なエンタープライズデータセンターは、遅かれ早かれ1.6Tの速度を採用する可能性が高いでしょう。

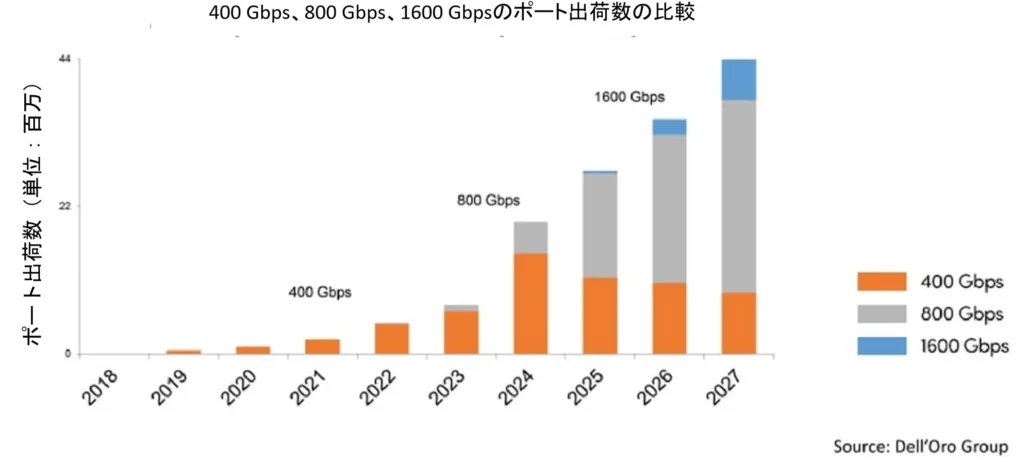

調査会社Cignal AIの最新のOptical Components Reportによると、800Gは2025年において市場で最も急速に成長するセグメントとなり、1.6Tへの移行は第3四半期に開始され、2026年および2027年にかけて加速していくとされています。これは、Dell’Oro Groupが公表した400G、800G、および1.6T(1600G)のポート出荷予測と一致しています。

800G/1.6Tに向けた通信技術オプション(PAM4・CWDM)

レーンあたり100ギガビット毎秒(Gb/s)を可能にする4値パルス振幅変調(PAM4)シグナリング技術の開発は、16本のファイバー(100 Gb/sで送信する8本と、100 Gb/sで受信する8本)を使用する8レーン800Gのマルチモードおよびシングルモードの並列光アプリケーションへの道を開きました。また、デュプレックスファイバー上で8つの異なる波長を使用する、8レーン800Gのシングルモード粗波長分割多重(CWDM)アプリケーションも可能にしました。802.3dfの批准以降、業界は光およびデジタル信号処理技術の進展により、レーンあたり200 Gb/sのPAM4シグナリング技術の実現に成功しています。

レーンあたり200 Gb/sに基づくIEEE 802.3dj 1.6T標準は、現在、2026年半ばまでにリリースされると見込まれています。いくつかのスイッチメーカーは、すでにこのシグナリング技術に基づく1.6Tトランシーバーを提供しています。Broadcomは2024年9月に1.6Tトランシーバーを発表し、いくつかの他社もそれに続きました。

表1は、データセンター環境において800Gおよび1.6Tを展開するためのさまざまなオプションを概説しています。

800Gデータセンター設計における主要インフラの考慮事項

800G、そして最終的には1.6Tのアプリケーションへの移行を検討しているデータセンターには、いくつかの重要なファイバーインフラに関する考慮事項があります。

現在、8本のファイバーで400G(400GBASE-SR4)をサポートしているマルチモードファイバーインフラは、800Gをサポートするためにその2倍のファイバー量を必要とします。2つのMPO-8/12コネクタで800Gをサポートするためのオプションもありますが、16ファイバー接続の方がより高い密度を提供します。スペースを節約するために、データセンターはSN-MTやMMCなどの16ファイバー対応の超小型フォームファクタ(VSFF)コネクタを検討することが望ましい場合があります。これらはマルチモードで利用可能です。

WDMアプリケーションにより、デュプレックスコネクタを使用して800Gおよびそれ以上を実現することが可能になりますが、コストおよび2000メートルを超える距離の必要性が限られていることから、並列光はデータセンターリンクにおける主要なアプローチであり続けます。そのため、多芯ファイバーコネクタは引き続き事実上のインターフェースとなります。

通常はシングルモードファイバーの用途と関連付けられることが多いAPC(angled physical contact)マルチモードMPOコネクタは、一般的に使用されているUPC(ultra-physical contact)ファイバー端面と比較して、反射を抑えるために400Gのマルチモード展開において普及しました。この傾向は、800Gのマルチモードアプリケーションにおいても継続すると考えられます。

800Gデータセンターにおけるリンク長と挿入損失のポイント

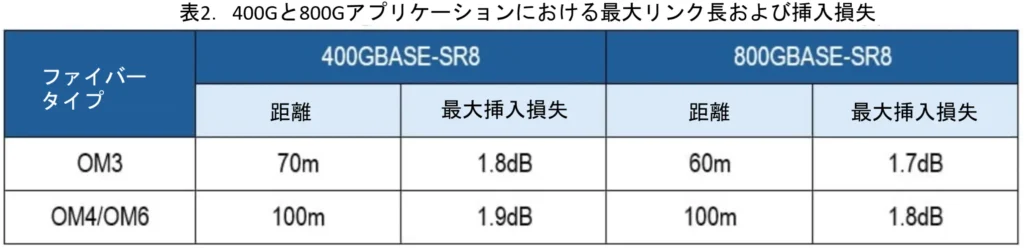

もう一つの考慮事項は、800Gマルチモードアプリケーションにおける最大リンク長と挿入損失の違いです。表2に示されているように、OM3は16ファイバーの400GBASE-SR8を最大70メートル、最大挿入損失1.8 dBでサポートしますが、16ファイバーの800GBASE-SR8については最大60メートル、最大挿入損失1.7 dBまでしかサポートしません。OM4/OM5ファイバーの距離制限は、400Gおよび800Gの両方において100メートルのままですが、挿入損失の値は400GBASE-SR8の1.9 dBから800GBASE-SR8の1.8 dBへと低下します。800Gへの移行を検討しているデータセンターは、自身のOM3リンクの長さを確認し、すべてのマルチモードリンクについて挿入損失のテストを実施して、800Gをサポート可能かどうかを判断する必要があります。これらのより厳格な損失バジェットは、1ジャンパー基準法を用いた正確な損失測定とともに、テストリファレンスコード、テスター入力、および試験対象リンクにおけるコネクタが確実に清浄であることを要求します。

もう一つの考慮事項は、デュプレックスファイバー上で4または8つの波長を用いて送受信を行うFR4およびFR8のCWDMシングルモードアプリケーションの使用です。FR4アプリケーションでは1271nm、1291nm、1311nm、および1331nmの波長が使用され、FR8ではこれに加えて1351nm、1371nm、1391nm、および1411nmの波長が追加されます。これらのアプリケーションのテストは、1310nmおよび1550nmの両方の波長で実施する必要があり、これにより一般的に使用されているすべての波長をカバーするのに十分です。

レーンあたり200 Gb/sで800Gおよび1.6Tをサポートすることを目的とした今後のIEEE 802.3dj標準は、現時点ではシングルモードファイバーのみを対象としている点に注意することが重要です。業界では、高レーンレートのアプリケーションに対して将来的に短距離マルチモードが検討される可能性があるという見方もありますが、HPCワークロードを支えるために800Gまたは1.6Tネットワークの導入を検討しているデータセンターは、通信速度のさらなる向上に伴う継続的なサポートを確保するために、シングルモードを検討することが望ましい場合があります。

800Gデータセンターにおけるコネクタ反射と対策(APC/UPC)

反射は、短距離シングルモードDRアプリケーションにおける重要な考慮事項です。これらのアプリケーションで使用される低コストのトランシーバーは反射を許容できないため、IEEEは接続の数および反射に基づいて損失制限を規定しています。800GBASE-DR8およびDR8-2においては、IEEEは-31 dBの反射値を持つ接続を2箇所までしか許容していませんが、-40 dBの反射値については8箇所まで許容しています。

リンク上の各コネクタの反射を測定するためには、光時間領域反射計(OTDR)を使用します。これはしばしば「Tier 2」テストと呼ばれ、光損失テストセット(OLTS)を用いてリンク損失を測定する「Tier 1」テストに対する追加の測定として実施されます。短距離シングルモードアプリケーションにおいては、個々のコネクタの反射の方がチャネルリターンロスよりもはるかに重要な懸念事項であるため、これらのアプリケーションではOLTSとOTDRの両方を用いた包括的なテスト戦略が有効です。

800G/1.6T時代のデータセンター移行計画と設計ポイント

800Gおよび1.6Tアプリケーションへの移行には、データセンターの現在の状況に応じて、慎重な計画と、場合によっては大規模なインフラのアップグレードおよび投資が必要となります。これらのより複雑なアプリケーションは、より大きな消費電力を伴い、それにより高度な冷却ソリューションが必要になる可能性があります。

そして、それで終わりではありません。スイッチメーカーはすでに、8レーン(16ファイバー)で3.2Tを実現する手段として、レーンあたり400 Gb/sのシグナリング技術の開発に取り組んでいます。これらの速度に対する需要は、先進的なAI駆動のワークロードによって生み出されており、これらはすでに400Gおよび800Gにおいてボトルネックを経験しています。レーンあたり400 Gb/sは、信号品質(シグナルインテグリティ)に関する追加の課題、消費電力、およびコストをもたらしますが、良い点としては、その時が来れば、現在800Gおよび1.6Tをサポートしているデータセンターのファイバーインフラは、将来的に3.2Tも問題なくサポートできると考えられます。

800Gおよびそれ以上への移行のどの段階にあるかに関わらず、これらの超高速リンクにおける信号品質(シグナルインテグリティ)を確保することは引き続き重要な優先事項であり、Fluke Networks のようなリーダー企業による高度な多芯ファイバーテスト機器が必要となります。

Cabling Cert Techによる解説(記事まとめ)

以上がフルーク・ネットワークスの原文翻訳です。以下では、Cabling Cert Techとして現場視点から重要なポイントを整理します。

本記事はFluke Networksの技術解説をベースにしていますが、ここでは現場視点から重要なポイントを整理します。

まず、800Gへの移行で最も影響が大きいのは「配線設計」と「損失管理」です。特にマルチモード環境では、従来の400G設計をそのまま流用すると、リンク長や挿入損失の制約により対応できないケースが発生します。

次に重要なのが「コネクタ品質と反射対策」です。APCコネクタの採用や端面清掃の徹底は、800G環境では必須レベルになります。わずかな汚れや反射でも、通信品質に大きな影響を与えるためです。

また、測定手法についても見直しが必要です。OLTSによる損失測定に加え、OTDRを用いた反射測定(Tier 2試験)を組み合わせることで、より確実な品質保証が可能になります。

さらに、将来の1.6Tや3.2Tへの拡張を見据える場合、シングルモードファイバーの採用も重要な検討ポイントとなります。特にAIやHPC用途では、通信速度のさらなる向上が前提となるため、初期設計の段階での判断が後の拡張性に大きく影響します。

800Gデータセンターは単なる高速化ではなく、「設計・施工・測定すべての精度が問われるフェーズ」に入っていると言えます。

関連情報:

ブログ:VSFFコネクターについて知っておくべきこと(フルーク・ネットワークス)

本記事について:本記事は、Fluke Networksが公式サイトで公開している「What You Should Know About VSFF Connectors」をCabling Cert Techが日本語に翻訳・ […]